本文共1047字

研調機構集邦科技(TrendForce)釋出最新針對高頻寬記憶體(HBM)市場研究顯示,為了更妥善且健全的供應鏈管理,輝達(NVIDIA)也規劃加入更多的HBM供應商,其中三星(Samsung)24GB的HBM3預期於今年12月在NVIDIA完成驗證。

而HBM3e進度依據時間軸排列如下表所示,美光(Micron)已於今年7月底提供24GB 的8層樣品、SK海力士(SK hynix)已於今年8月中提供24GB的8層樣品、三星則於今年10月初提供24GB 的8層樣品。

由於HBM驗證過程繁瑣,預計耗時兩個季度,因此,集邦科技預期,最快在2023年底可望取得部分廠商的HBM3e驗證結果,而三大原廠均預計於2024年第1季完成驗證。值得注意的是,各原廠的HBM3e驗證結果,也將決定最終NVIDIA 2024年在HBM供應商的採購權重分配,然目前驗證皆尚未完成,因此2024年HBM整體採購量仍有待觀察。

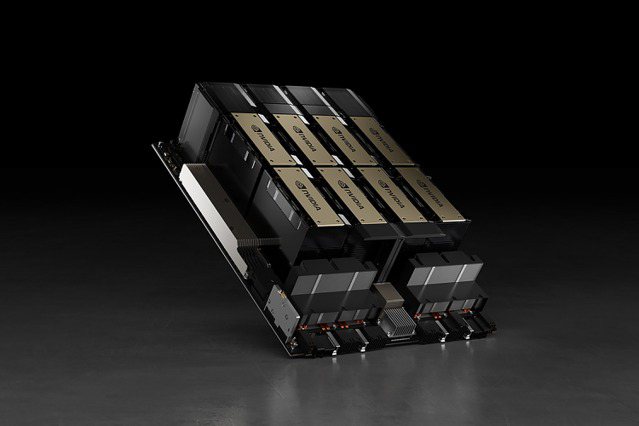

展望2024年,觀察目前各AI晶片供應商的開案進度,NVIDIA 2023年採用HBM的高階AI晶片既有產品為A100/A800以及H100/H800;2024年則將把產品組合更細緻化的分類。

除了原上述型號外,更再推出使用6顆HBM3e的H200以及8顆HBM3e的B100,並同步整合NVIDIA自家基於Arm架構的CPU與GPU,推出GH200以及GB200。

相比同時期的超微(AMD)與英特爾(Intel)產品規劃,AMD 2024年出貨主流為MI300系列,採用HBM3,下一代MI350將採用HBM3e,預計2024下半年開始進行HBM驗證,實際看到較明顯的產品放量(Ramp Up)時間預估應為2025年第1季。

以Intel Habana來看,2022下半年推出的Gaudi 2採用6顆HBM2e,2024年中預期在新型號Gaudi 3持續採取HBM2e,但將用量升級至8顆。因此,集邦科技認為,NVIDIA在HBM規格、產品準備度(Readiness)及時間軸上,可望持續以領先的GPU規格,在AI晶片競局取得領先。

最後,集邦科技也觀察到,針對HBM4,各買方也開始啟動客製化要求,除了HBM可能不再僅是排列在SoC主晶片旁邊,亦有部分討論轉向堆疊在SoC主晶片之上。雖然目前所有選項仍在討論可行性中,並尚未定案。

但集邦科技認為,未來HBM產業將轉為更客製化的角度發展,相比其他DRAM產品,在定價及設計上,更加擺脫標準型(Commodity)DRAM的框架,呈現特定化的生產。

※ 歡迎用「轉貼」或「分享」的方式轉傳文章連結;未經授權,請勿複製轉貼文章內容

留言