本文共926字

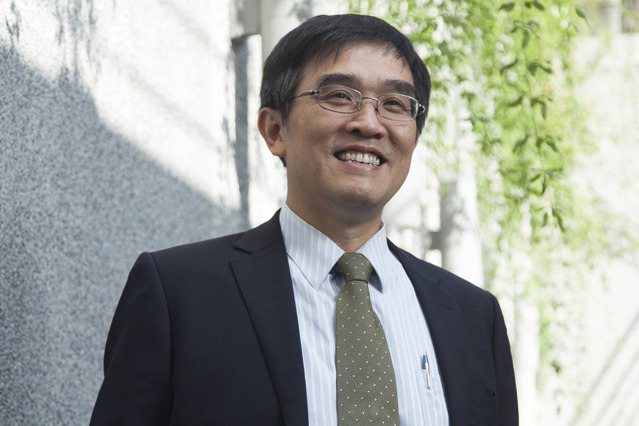

資策會今天發布企業生成式AI導入指引手冊,點出應思考導入評估與風險2大方向,要有管理措施確保生成式AI的風險在可控範圍內。資策會執行長卓政宏表示,希望指引讓企業了解導入生成式AI時,怎麼用比較合理。

資策會今天下午舉行「數位信任治理生態」論壇,邀行政院副院長鄭文燦等各界專家,探討信任在數位化社會中的意義。活動現場同步展示資策會三大類AI研發成果,並發布23頁的「生成式AI導入指引-企業應具備的AI素養」手冊。

卓政宏受訪時表示,人工智慧快速發展讓很多人感到焦慮,資策會希望踏出第一步,因此草擬指引。生成式AI還在比較初階的階段,希望指引可以讓企業面對AI、或導入生成式AI時,知道怎麼使用比較合理。

根據資策會指引,生成式AI除了帶來正面影響,也可能有負面衝擊,例如:為了讓AI學習,不小心洩漏組織的機敏資料;濫用智慧財產權;取代現有人力;AI可能混淆對於事實的正確認知等。希望透過指引幫企業了解AI對組織的影響,並建構組織的AI能力。

指引點出「生成式AI導入與評估」與「風險管理」兩大方向。在導入與評估面向,企業若要導入生成式AI,必須從組織面、技術面、資料面、人才面、管理面、政策面6大方向思考,組織要明確了解內部策略目標以及生成式AI所需資源分配,選擇生成式AI模型時也要評估性能與適用性等,並建立熟練的AI團隊,也要有管理措施,確保生成式AI的效果或風險在可控範圍內。

資策會提醒,企業要直接使用軟體工具、透過API(應用程式介面)串接外部模型、針對開源模型微調,或是自行訓練企業的內部模型,皆會面臨不同考量。企業若自行訓練模型,也要注意公開資料的知識版權問題,避免違反法規規範。

風險評估上,資策會指引提到,要留意公平性、隱私性、安全性、知識產權(IP)確認和授權等問題。例如,生成式AI所產生的內容、圖片甚至軟體,在智慧財產權的歸屬是一個待解的議題,此外,AI系統也要防範駭客入侵攻擊等。

國科會日前也提出行政院及所屬機關使用生成式AI參考指引草案,提到機密文件禁止使用到生成式AI,在資策會指引中則有更完整的討論。資策會副執行長楊仁達會後受訪時表示,如果企業是內部自建模型做生成式AI,那的確可能輸入企業機敏資料,但就是限內部使用。

※ 歡迎用「轉貼」或「分享」的方式轉傳文章連結;未經授權,請勿複製轉貼文章內容

留言