本文共679字

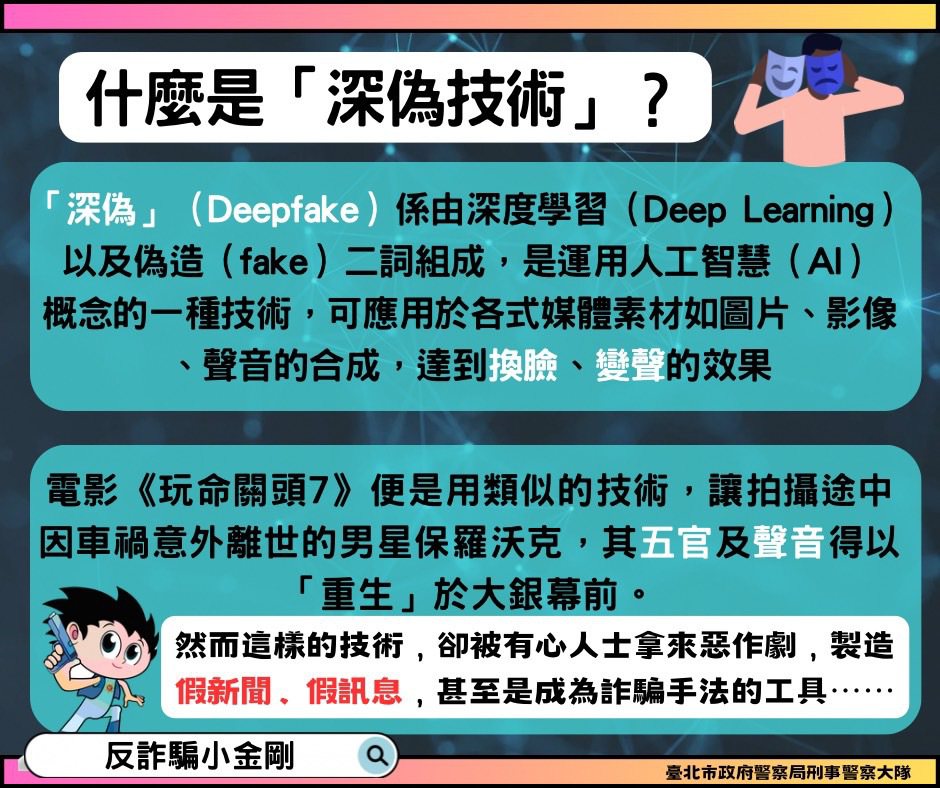

台北市刑大今天提醒民眾,近期火紅的AI(Artificial Intelligence)人工智慧,有一種「深偽(Deepfake)」技術應用,結合深度學習和影像合成,能以逼真方式替換或操縱現有的媒體內容,達到換臉、變聲等效果;未來詐騙手法恐怕會結合深偽技術,讓人防不勝防。

北市刑大指出,早期「深偽」技術犯罪,主要與偽造成人影片(如Youtuber小玉的換臉事件)或模仿政治人物、名人進行宣傳有關,涉及假訊息散布、誹謗以及侵犯個人隱私等罪刑。隨著技術取得愈發容易,應用範圍逐漸擴展到其他領域,包括娛樂、新聞、社交媒體,乃至詐騙手法的精進。

台北市警察局研析,列出下列深偽結合詐欺的手法:

一、電話詐騙(猜猜我是誰):模仿特定人物聲音的功能,恐遭歹徒用於仿冒家人、朋友或其他知名人士的聲音,向受害者索取金錢與個人資料。

二、視訊詐騙:深偽技術可用在合成擬真的影片、語音,或結合視訊功能,冒充企業高層,藉此對下屬發送虛假的指示,例如要求轉移資金或提供機密信息。近期大陸就出現一起科技公司老闆,接到AI換臉詐騙視訊電話的案例,一夕間遭詐430萬人民幣(約1873萬新台幣)。

三、恐嚇詐騙:個人肖像可能遭詐騙集團移花接木,用以合成不雅照片,再寄送當事人恐嚇勒索。今年3月有多名國內大學教授,收到類似的合成照片與恐嚇信息的騷擾。

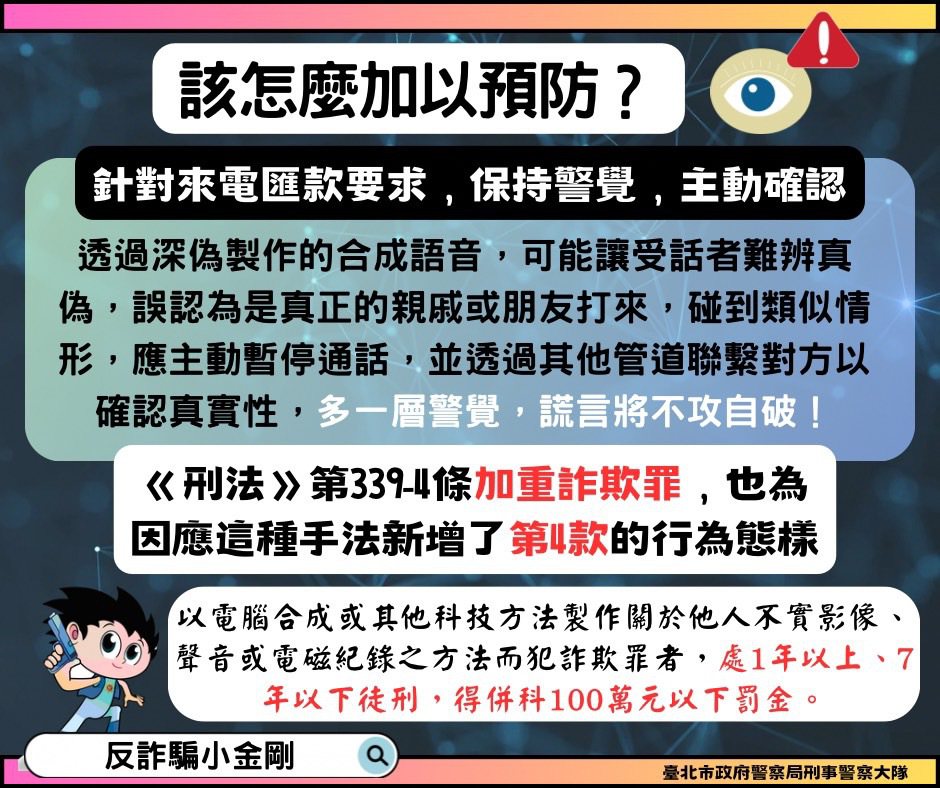

台北市警察局呼籲民眾,面對科技進步帶來的犯罪威脅,最重要是保持警惕和懷疑心態,不輕易相信或分享未經驗證的內容,並審慎對待來自陌生人,甚至是親朋好友的請求,接受媒體內容時,特別是容易引起關注的內容,應該檢查來源可信度,化被動為主動,確保信息真實可靠。

※ 歡迎用「轉貼」或「分享」的方式轉傳文章連結;未經授權,請勿複製轉貼文章內容

留言